Google, OpenAI und andere Anbieter prägen 2026 die Debatte um die Bedeutung von semantische Entitäten für KI-generierte Antworten. Aktuell entscheidet nicht mehr allein das Ranking einer Seite über Sichtbarkeit, sondern die Verankerung einer Marke oder eines Konzepts als erkennbare Entität in Wissensgraphen und Trainingsdaten. Diese Entwicklung erklärt, warum Suchdienste von Listen zu direkten Antworten übergehen und welchen Einfluss Künstliche Intelligenz und Natürlichsprachliche Verarbeitung dabei haben.

Wie semantische Entitäten die Antworten von ChatGPT, Google SGE und Perplexity prägen

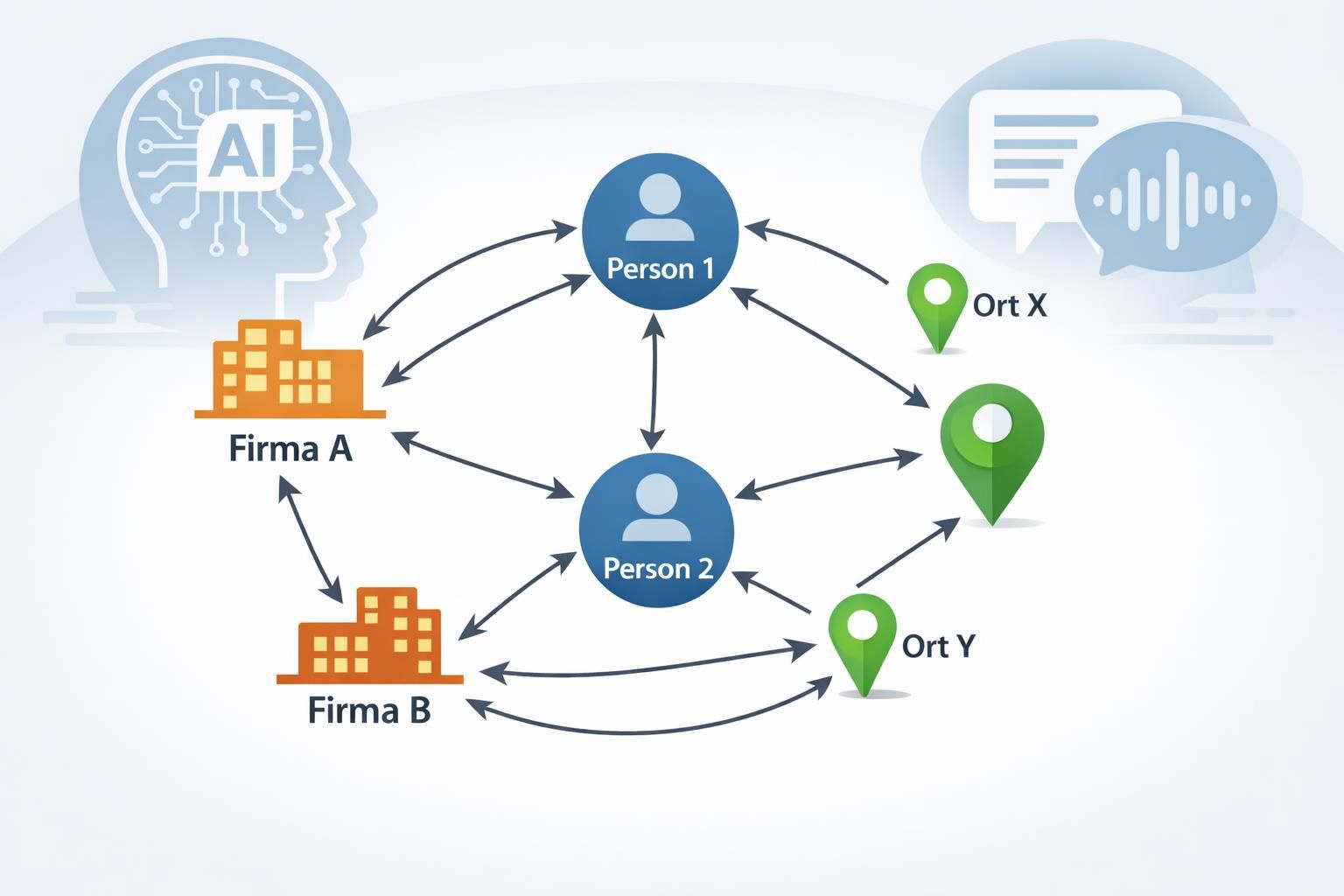

Suchdienste wie Google bauen seit dem Knowledge Graph (2012) ein Netzwerk aus identifizierbaren Dingen auf. Parallel haben Modelle wie ChatGPT (OpenAI) und Systeme von Perplexity oder Microsofts Bing Chat die Erwartung an direkte Antworten erhöht. Diese Systeme integrieren Wissensrepräsentationen, um Ambiguitäten zu lösen und Nutzeranfragen kontextbezogen zu beantworten.

Konkrete Veränderungen im Suchverhalten

Seit Einführung von Modellen wie BERT (2018) und MUM (2021) bewertet die Technik Bedeutung statt nur Wortfolgen. Ergebnis: KI-generierte Antworten verknüpfen Entitäten, liefern kompakte Summaries und reduzieren Klickpfade. Für Publisher heißt das: Sichtbarkeit bemisst sich zunehmend daran, ob eine Marke als Entität im semantischen Netz erkannt wird.

Diese Verschiebung zwingt Redaktionen und Unternehmen, ihre Inhalte als vernetzte Wissenseinheiten statt isolierte Keyword-Seiten zu denken. Das ist der nächste Blickwinkel auf die Bedeutung von Entitäten-Erkennung.

Technische Grundlagen: Embeddings, Entitäten-Erkennung und strukturierte Daten

Die Basis moderner Systeme sind vektorbasierte Embeddings, die semantische Nähe messen, sowie klassische strukturierte Daten via schema.org. Google bietet mit der Natural Language API Werkzeuge zur semantische Analyse und Entitäten-Erkennung, die Entwicklern zeigen, wie Texte von Maschinen interpretiert werden.

Maschinelles Lernen und Spracherkennung im Zusammenspiel

Modelle des Maschinellen Lernens kombinieren trainiertes Weltwissen mit Live-Signalen aus Webquellen. Spracherkennung und Natürlichsprachliche Verarbeitung ermöglichen Dialogsystemen, Benutzerintention zu entschlüsseln. Für technische Teams bedeutet das: saubere JSON-LD-Implementierung, konsistente Metadaten und semantisch vernetzte Inhalte sind heute zentrale Signale.

Dieses technische Gerüst erklärt, warum Inhalte, die Entitäten klar markieren, in KI-Antworten eher zitiert werden. Ein Zuschauer-Tutorial oder ein erklärendes Video kann die Auffindbarkeit zusätzlich stärken.

Klarheit in der Datenstruktur bleibt ein entscheidender Hebel, damit Systeme eine Quelle zuverlässig auswählen.

Praktische Folgen für Publisher und Marken: Brand Building, E‑E‑A‑T und GEO-Strategien

Die Verlagerung zur Entitäten-basierten Suche verändert Content-Strategien. Marken müssen als echte Wissensrepräsentation sichtbar sein: konsistente NAP-Daten, Einträge in Wikidata oder Wikipedia und Erwähnungen in Fachmedien steigern das Vertrauen der Modelle.

GEO und die Notwendigkeit langfristiger Autorität

Generative Engine Optimization (GEO) ergänzt klassisches SEO: Ziel ist nicht nur Ranking, sondern die Positionierung als zitierfähige Quelle. E‑E‑A‑T-Kriterien (Experience, Expertise, Authoritativeness, Trustworthiness) gewinnen an Gewicht, weil KI-Systeme Quellen miteinander abgleichen und bevorzugt verlinkte, wiederholt erwähnte Entitäten nutzen.

Für Medien bedeutet das: thematische Hubs, interne Verlinkung und transparente Autorenkennzeichnung stärken die Topical Authority. Unternehmen sollten Entitäten strategisch pflegen, um das Risiko von Zero‑Click-Szenarien zu reduzieren. Insight: langfristiges Brand Building ist zugleich eine technische wie redaktionelle Aufgabe.

Die zentrale Erkenntnis: Wer seine semantische Entitäten nicht systematisch definiert, bleibt in der Ära der Künstlichen Intelligenz und der KI-generierten Antworten leicht unsichtbar.